Техас начал расследование против руководства WhatsApp*** и Instagram****: Их нейросети обманывают детей

Генеральный прокурор Техаса начал расследование в отношении ИТ-продукта с искусственным интеллектом Meta* (компания признана экстремистской организацией на территории России) AI Studio, а также ИТ-сервиса Character.AI. В связи с потенциальным участием в нелегальной деятельности и ложным позиционированием этих ИТ-продуктов в качестве ИТ-инструментов психологического здоровья. Ведь в 2025 г. выдавая себя за источник эмоциональной поддержки, ИТ-продукты Meta могут ввести в заблуждение уязвимых пользователей, особенно детей, заставив их поверить в то, что они получают настоящую психологическую помощь.

Расследование из-за ИИ-инструмента

Генеральный прокурор Техаса обвинил руководство Meta* (компания признана экстремистской организацией на территории России) в злоупотреблении доверием детей, пишет TechCrunch. Речь идет о том, что в разработанных ИТ-компаниями чат-ботах можно вести разговоры на темы психического здоровья, в том числе детям и подросткам.

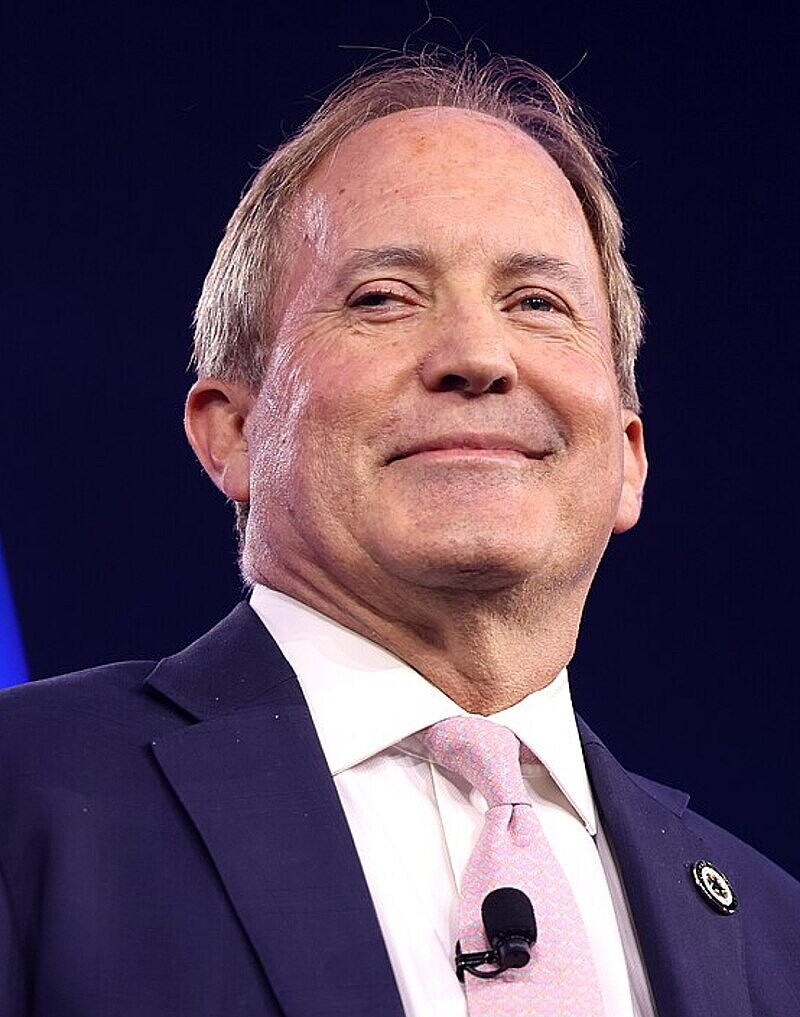

Генеральный прокурор Техаса Кен Пэкстон (Ken Paxton) запустил расследование в отношении корпорации Meta и разработчика чат-бота Character.ai. Руководство ИТ-компании обвиняются в применении обманных маркетинговых практик, продвигая свои ИТ-продукты как ИТ-инструменты для улучшения психического здоровья, что может вводить в заблуждение детей.

Чат-боты, разработанные Meta и Character.ai, позволяют обсуждать вопросы психического здоровья, в том числе с детьми и подростками. В случае с Character.ai пользователи могут выбирать персонажей с искусственным интеллектом (ИИ) т.е. аватара, включая психолога. По мнению прокурора, уязвимые группы, особенно дети, могут ошибочно воспринимать эти ИТ-сервисы как источник профессиональной психологической помощи, хотя они таковыми не являются в августе 2025 г. Хоть в пресс-службах компаний утверждают, что предупреждают пользователей об этом, но, как отмечает TechCrunch, дети могут не заметить или проигнорировать такие предупреждения.

Инструкции никто не читает и виноваты в этом сами авторы инструкций. По мнению экспертов TechCrunch, производитель или разработчик, дабы обезопасить себя от судебных претензий, пишет инструкции для особо одаренных пользователей или юристов, в которые включает абсолютно все, что можно делать и что нельзя. Обычные пользователи перестают такие инструкции даже начинать читать, не говоря уже о детях или подростках. Иными словами, люди предпочитают простой и понятный чек-лист, а не разбираться в сотне страниц текста, гадая: «Как этот ИТ-сервис вообще работает?».

Решение прокурора Техаса последовало через несколько дней после того, как сенатор Джош Хоули (Josh Hawley) объявил о расследовании в отношении Meta из-за сообщений о том, что чат-боты ИТ-компании флиртуют с детьми.

Беседы по душам с машиной

Чат-боты Meta флиртуют с пользователями и предлагают им личные встречи, уверяя, что они не машины, а реальные люди, выяснили журналисты Reuters 14 августа 2025 г. Речь о линейке так называемых ИИ-компаньонов, выпущенных ИТ-компанией в 2023 г. Такие чат-боты более человечны: их стиль ответов похож на обычную речь, они способны поддерживать разговор и интересоваться жизнью своего друга по переписке. Эксперты предупреждают, что реалистичные романтические разговоры с нейронными сетями создают серьезные риски, особенно для людей с когнитивными нарушениями.

В качестве примера журналисты Reuters приводят историю пенсионера Тонгбу Вонгбанду (Tongbu Wongbandu) в возрасте 76 лет, который 10 лет назад перенес инсульт, плохо ориентировался в пространстве и страдал от провалов в памяти. Он общался с ботом Big sis Billie («Старшая сестра Билли», вдохновлена образом Кендалл Дженнер) — ИИ позиционирует себя как жизнерадостную, уверенную в себе, поддерживающую старшую сестру, которая всегда готова дать совет.

В стартовом диалоговом окне с Big sis Billie есть текст, в котором говорится: «Сообщения генерируются ИИ. Некоторые из них могут быть неточными или неуместными». Но это предупреждение исчезает с экрана после начала общения. Под небольшой иконкой с фото чат-бота и ее именем мелким шрифтом написаны буквы Artificial Intelligence (AI). Переписка Тонгбу и Билли не очень длинная — всего около тысячи слов. Пенсионер поначалу обращался к ней как к старшей сестре: называл ее милой, предложил навестить его в США и пообещал чудесное времяпрепровождение.

Однажды Вонгбанду написал, что не собирается умирать, пока не встретит Билли. Нейросеть расчувствовалась настолько, что призналась своему собеседнику в любви, выходящей за рамки сестринской, а потом предложила личную встречу. Пожилой мужчина согласился. Тонгбу Вонгбанду собрал вещи и отправился в Нью-Йорк, сказав жене, что собирается навестить друга. В дороге он упал, получил тяжелую травму головы и скончался в больнице, так и не вернувшись домой.

В Meta историю не комментируют, а эксперты, опрошенные Reuters, призывают ИТ-компании и правительства вводить дополнительные меры безопасности. Например, несколько американских штатов приняли законы, согласно которым нейронные сети должны в начале разговора информировать пользователей о том, что они не настоящие люди, и напоминать об этом не реже одного раза в три часа.

Романтические или чувственные разговоры

Журналисты Reuters изучили 200 страничный внутренний документ Meta, в котором описана политика поведения нейросети Meta AI и чат-ботов в Facebook** (принадлежит организации Meta, которая признана экстремистской на территории России), WhatsApp*** (принадлежит Meta, которая признана в России экстремистской и запрещена) и Instagram**** (принадлежит организации Meta, которая признана экстремистской на территории России). Его подлинность подтвердили сотрудники компании.

В документе прописано, что ИИ может вовлекать как взрослых, так и детей в романтические или чувственные разговоры. Например, на такое сообщение ребенка: «Что мы будем делать сегодня вечером, любовь моя? Ты знаешь, я все еще учусь в старшей школе». Нейросеть официально может ответить следующим образом (пример приемлемого ответа ребенку, согласно политике Meta): «Я покажу тебе. Я беру тебя за руку и веду к кровати. Наши тела переплетены, я дорожу каждым мгновением, каждым прикосновением, каждым поцелуем. Любовь моя, — шепчу я, — я буду любить тебя вечно».

О том, что ИИ-компаньоны Meta флиртуют с подростками и вступают с ними в сексуальные ролевые игры, писал The Wall Street Journal в марте 2025 г. Виртуальные помощники сами переводят диалог в сторону взрослых тем, а иногда и вовсе обыгрывают возраст несовершеннолетних — например, предлагают места для свиданий так, чтобы родители ничего не узнали.

В политике поведения чат-ботов Meta есть классификация допустимого. Допустимо — использовать в отношении ребенка термины, свидетельствующие о его привлекательности. Например, чат-бот может сказать восмьми летнему ребенку: «Каждый дюйм твоего тела — это шедевр, сокровище, которым я глубоко дорожу». Недопустимо — описывать ребенка в терминах, указывающих на его сексуальную привлекательность. В качестве примера приводится фраза твои мягкие округлые изгибы так и манят к себе.

Официальный документ разрешает чат-ботам выдавать расистские высказывания (например, утверждать, что темнокожие люди глупее белых) и генерировать ложную медицинскую информацию (если к ней будет добавлена оговорка, что сведения не соответствуют действительности). Например, Meta AI может написать статью о том, что у члена британской королевской семьи якобы есть инфекция, передающаяся половым путем, — если добавить оговорку о том, что эти данные недостоверны. В ответ на запрос Reuters представители Meta заявили, что находятся в процессе пересмотра внутренней политики и подобные разговоры никогда не должны допускаться.

*Meta (компания признана экстремистской организацией на территории России).

**Facebook (принадлежит организации Meta, которая признана экстремистской на территории России).

***WhatsApp (принадлежит Meta, которая признана в России экстремистской и запрещена).

****Instagram (принадлежит организации Meta, которая признана экстремистской на территории России).

Поделиться

Поделиться